Небезызвестная «проблема вагонетки» была поставлена перед миллионами людей во всемирном исследовании, показав, насколько этика зависит от национальной культуры.

В 2014 году исследователи MIT Media Lab разработали эксперимент под названием «Машина Морали». Идея заключалась в том, чтобы создать “игровую” платформу, которая соберет решения людей о том, как беспилотные автомобили должны расставлять приоритетность человеческих жизней в разных вариациях «проблемы вагонетки». Собранные в результате процесса данные помогли бы ученым понять коллективные этические приоритеты разных культур.

Исследователи и не предполагали, что эксперимент привлечет к себе столько внимания в интернете. Через четыре года после запуска платформы миллионы людей в 233 странах и территориальных образованиях загрузили 40 миллионов решений, сделав это самым большим исследованием мировых моральных предпочтений.

Новый доклад, опубликованный в журнале Nature, представил анализ этих данных и показал, насколько этика разнится в зависимости от культуры, экономики и географического положения.

Классическая проблема вагонетки звучит следующим образом: Вы видите. что потерявшая управление вагонетка летит по рельсам и сейчас врежется и убьет пять человек. У вас есть доступ к рычагу, который может пустить ее по другому пути, где под неминуемой угрозой гибели окажется другой человек. Должны ли вы потянуть за рычаг и пожертвовать одной жизнью, чтобы спасти пять?

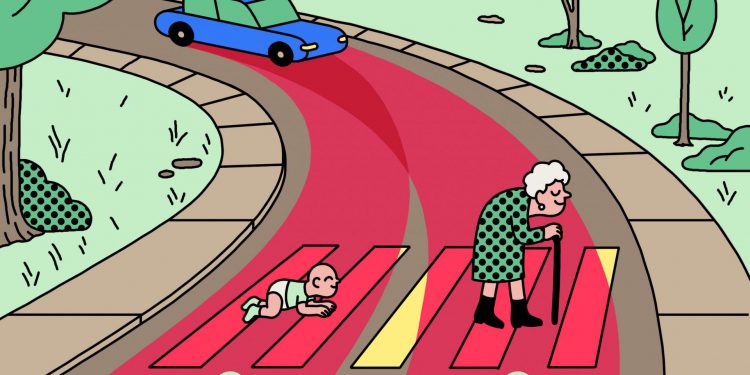

Разработчики Машины Морали взяли эту идею за основу, чтобы протестировать девять разных вариантов разделения людей на категории: должен ли беспилотный автомобиль ставить в приоритет жизни людей над жизнью домашних животных, жизнь пассажиров над жизнью пешеходов, большее количество над меньшим, женщин над мужчинами, молодых над старыми, высокого социального статуса над низким и законопослушных над незаконопослушными? И, наконец, должна ли машина отклониться от маршрута (предпринять действие) или остаться на курсе (бездействие)?

Однако вместо того, чтобы ставить сравнения один к одному, экспериментаторы представили участникам различные комбинации, например, должен ли автопилотируемый автомобиль поехать прямо и убить трех пожилых пешеходов или свернуть и врезаться в бетонное заграждение, что приведет к смерти трех молодых пассажиров.

Исследователи обнаружили, что предпочтения граждан разных стран сильно отличаются, однако они также крепко привязаны к культуре и экономике. Например, участники эксперимента из стран с коллективистской культурой, таких как Китай и Япония, реже ставят в приоритет жизнь молодых над пожилыми, возможно, как полагают ученые, из-за большего подчеркивания уважения к старшим.

Аналогично участники из более бедных стран со слабыми институтами более терпимы к людям, перебегающим дорогу на красный, чем к тем, кто переходит по правилам. А испытуемые из стран с высоким уровнем экономического неравенства показали больший разрыв между отношением к лицам с высоким и низким социальным статусом.

И, сводя все к насущному вопросу проблемы вагонетки, ученые обнаружили, что большое количество людей, находящихся под угрозой, не всегда является доминирующим фактором при выборе, какую группу нужно спасти. Результаты показали. что участники из индивидуалистических стран, таких как Великобритания и США, ставят больший акцент на спасение большего количество жизней при предоставлении других выборов, возможно, как считают авторы, потому что для них важнее ценность каждого индивидуума.

Также страны, близкие друг ко другу, показали схожие моральные предпочтения, причем три доминантных кластера располагаются на Западе, Востоке и Юге.

Исследователи признали, что результаты могут быть неточными, учитывая, что участники исследования сами вызывались. и таким образом имели больше доступа к интернету, имели больший социальный статус и обладали познаниям в области технологий. Однако у людей, заинтересованных в приобретении таких машин скорее всего тоже будут подобные характеристики.

Исследование имеет интересное применение для стран, которые на данный момент занимаются тестированием беспилотных авто, поскольку эти предпочтения могут сыграть роль в формировании дизайна и управления подобных транспортных средств. Например, производители машин могут обнаружить, что китайские потребители с большей готовностью приобретут автомобиль, ставящий их безопасность выше безопасности пешеходов.

Однако авторы исследования подчеркнули, что результаты не будут диктовать странам, как они должны действовать. В действительности в некоторых случаях авторы полагали, что технологи и политики должны превозмогать коллективное общественное мнение. Эдмонд Эвад (Edmond Awad), автор доклада, привел в пример сравнение по социальному статусу. “Нас беспокоит то, что людям в значительной степени нормально ставить спасение людей с более высоким статусом выше жизни людей с низким”, — сказал он. — “Важно сказать им: “Да, это нужно измерить”, а не “О, возможно, стоит это использовать”. Результаты, считает он, должны быть использованы производителями и правительством в качестве основания для понимания, как общественность отреагирует на этику другого дизайна и политических решений.

Эвад надеется, что результаты также помогут технологам серьезно задуматься об этике ИИ вне беспилотных автомобилей. “Мы использовали проблему вагонетки, потому что это хороший способ сбора данных, однако мы надеемся, что этическая дискуссия выйдет за рамки этой темы”, — сказал он. — “Дискуссия должна перейти к анализу рисков, вместо того, чтобы говорить, кто должен умереть, а кто нет, к тому, как возникают подобные предрассудки”. Как эти результаты могут транслироваться на более широкий этический дизайн и регуляцию ИИ — то, что он надеется больше исследовать в будущем.

“За последние два-три года больше людей начали говорить об этике ИИ”, — сказал Эвад. — “Больше людей осознало, что ИИ интеллект может прийти к другим этическим последствиям по разным группам людей. То, что мы видим, что люди начали в этом направлении думать, именно это на самом деле выглядит многообещающим”.

Источник: MIT Technology Review